自动驾驶核心壁垒崩塌!英伟达开源VLA大模型,吴新宙领军,海量数据免费用

准备好了吗?就在刚才,英伟达将高阶自动驾驶的核心钥匙,向全球开发者彻底公开!

英伟达(NVIDIA)研究团队正式开源其全新的视觉-语言-动作(VLA)模型——Alpamayo-R1(简称AR1),并宣布即将开放部分核心数据集。

Alpamayo-R1对应的数据集已上传至开源社区

目前,规模高达约100TB的数据集已同步开源,这是英伟达首次开放VLA模型全家桶。

更关键的是,英伟达明确授权该数据集可用于商业及非商业用途。这意味着,任何公司都能借助这套资源,快速切入VLA赛道。

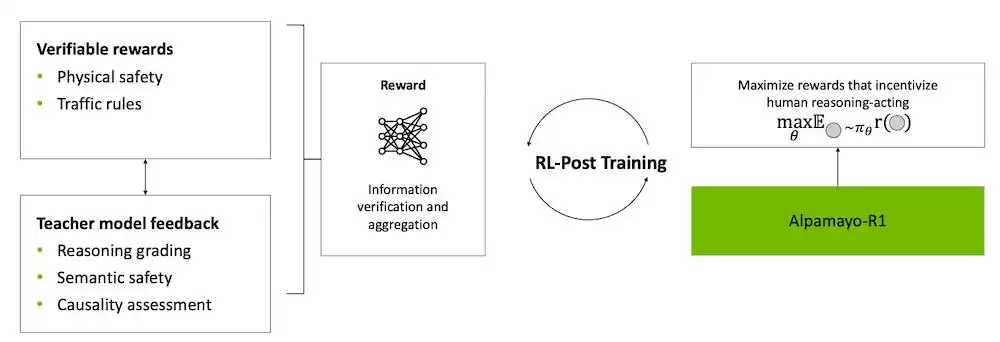

Alpamayo-R1模型架构

此举不仅击碎了高端自动驾驶的技术垄断,更标志端到端系统从“行为模仿”跃升为具备“因果推理”的真实智能。

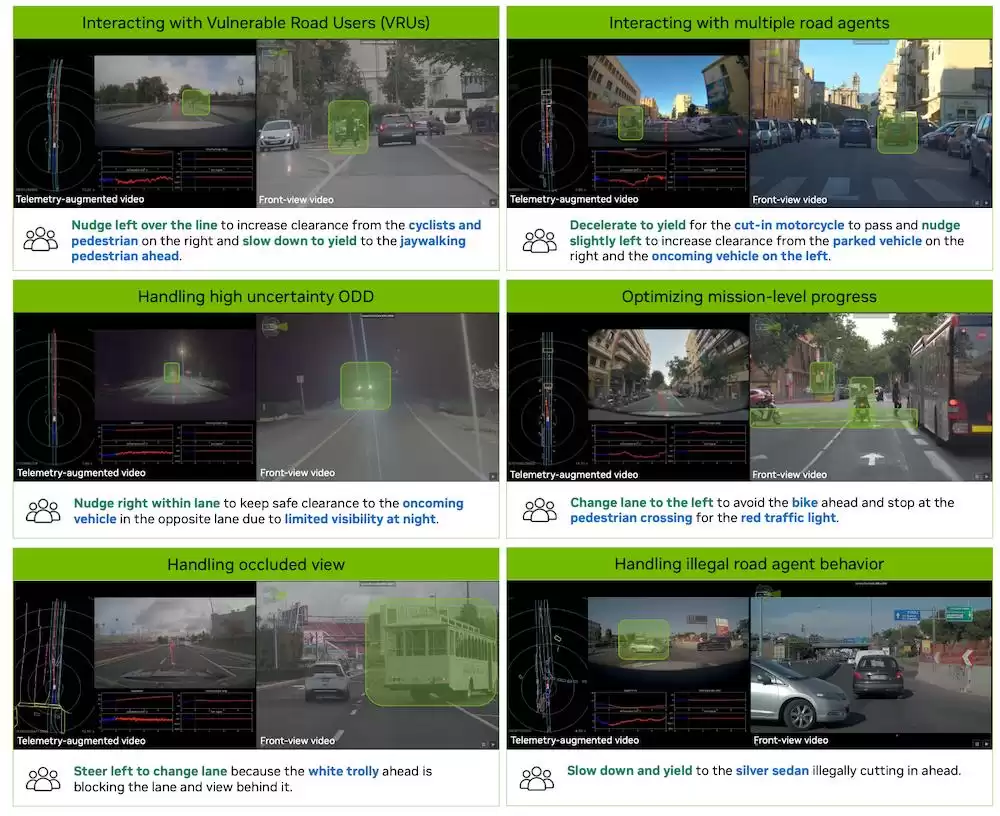

它直指行业最棘手的痛点——应对极端、罕见的长尾场景。

而Alpamayo-R1交出的答卷,堪称惊艳。

Alpamayo-R1相对基线的提升明显

在超高难度长尾场景测试中,AR1的规划准确率相比传统基线模型暴增12%;

闭环仿真中,AR1将车辆驶出道路的事故率猛降35%;

与交通参与者的危险近距离遭遇率也锐减25%。

更惊人的是,集成强大推理能力后,该模型在NVIDIA RTX 6000 Pro Blackwell硬件上,仍保持99毫秒的端到端超低延迟,完全满足实时驾驶的极限要求。

01.

解决自动驾驶端到端黑盒问题

引入因果链数据集

过去,基于模仿学习的端到端模型虽数据海量,却只是个“机械黑盒”——能复制操作,不懂背后因果。

这导致面对未知复杂路况时,车辆决策往往脆弱甚至矛盾。

将“世界知识”注入驾驶系统,正是攻克L4长尾难题的关键路径。

理想汽车VLA模型架构

VLA研发受制于模型幻觉、高延迟及巨量算力数据需求,目前仅少数头部玩家涉足。

开源领域,除英伟达AR1外,也仅有OpenDriveVLA等学术项目。

英伟达此番开源,无异于向行业投下一枚“核弹”,彻底改变游戏规则。

为实现真正的人类级思考,英伟达从数据底层发动革命,构建了全新的“因果链”(CoC)数据集。

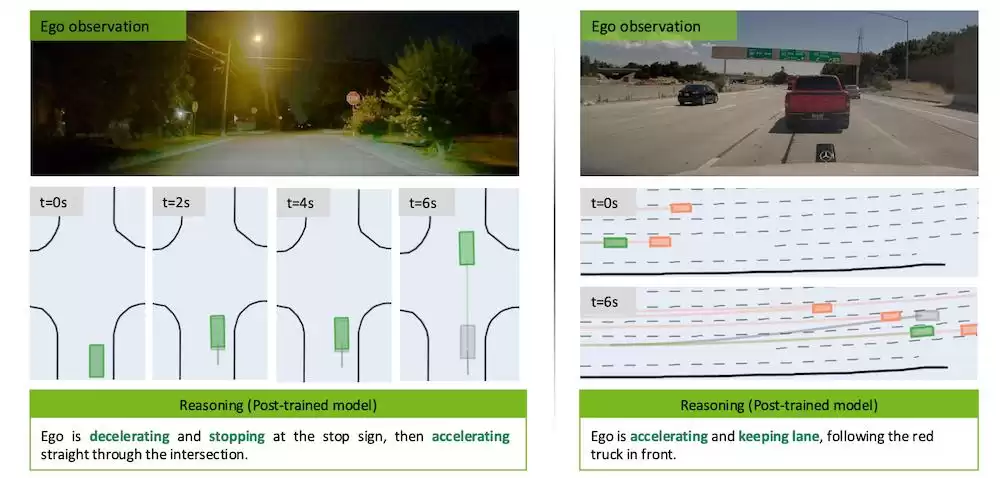

因果链推理演示

它摒弃模糊描述,强制模型建立“观察-推理-行动”的严密逻辑。例如,指令明确为:“因左侧车辆强行并线且行人横穿,故执行减速避让”。

这种数据构建极大消除了因果混淆,让模型决策逻辑清晰可信。

02.

引入新架构 平衡模型性能

基于强悍数据,Alpamayo-R1采用模块化架构,巧妙平衡“深度思考”与“瞬时反应”。

其“大脑”由专为物理AI打造的Cosmos-Reason模型驱动,负责环境理解与推理;“手脚”则交由基于流匹配(Flow Matching)技术的动作解码器,生成顺滑轨迹。

分工协作机制,既融汇大语言模型的广博知识,又通过扩散模型保障响应速度,根治了大模型延迟痛点。

但Alpamayo-R1的真正杀手锏,在于训练中引入的强化学习(RL)机制。

推理-动作高一致性将提升奖励

在监督学习掌握基础驾驶后,一个更严苛的“AI判官”上场——用大规模推理模型作为批评者,为AR1的表现打分。

训练目标极致明确:言行必须一致。若模型推理“因红灯停车”却实际加速,将受重罚。

采用强化学习新模式后质量显著提升

这迫使AI的解释成为真正的行动纲领,推理质量因此飙升45%,推理与行动一致性提高37%。

论文致谢中排首位的,正是英伟达自动驾驶负责人吴新宙。

吴新宙在致谢第一位

这位行业领袖原为小鹏汽车自动驾驶副总裁,2023年加盟英伟达,现任汽车业务副总裁,直接向黄仁勋汇报,全面执掌自动驾驶软件算法研发。

03.

结语:英伟达首次开源VLA模型

Alpamayo-R1的开源,远不止发布一个模型。它预示自动驾驶行业洗牌的开始。

曾经被巨头垄断的高阶技术壁垒,如今被英伟达亲手拆解。这套L4级“参考答案”,将极大降低中小厂商与机构的入场门槛,催生百花齐放的微调方案。

对英伟达自身,这正是其“软硬一体”战略的完美落子。AR1的卓越性能,深度绑定其顶级GPU算力与Cosmos工具链。通过定义软件范式,英伟达正悄然锁定未来的硬件帝国。

本文来自微信公众号“车东西”,作者:Janson,编辑:志豪,36氪经授权发布。

相关问答

想立即体验未来驾驶?快获取开源模型!

Flow技术是一个快速、安全且对开发者友好的区块链,旨在支持下一代游戏、应用及数字资产。它由打造CryptoKitties的Dapper Labs构建...